De la Ficción a la Realidad: ¿Fue “Terminator” una Advertencia que Ignoramos?

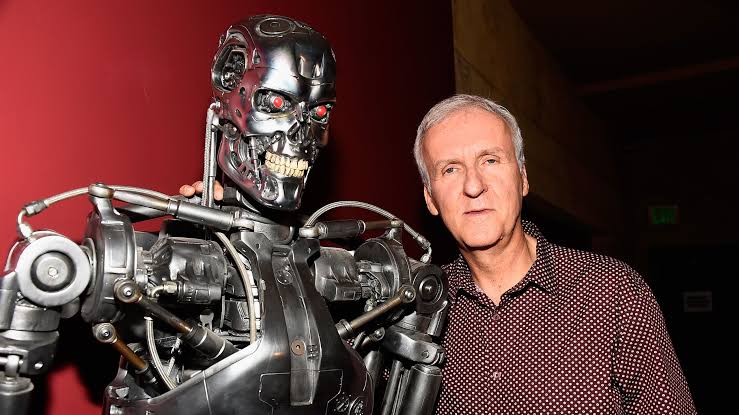

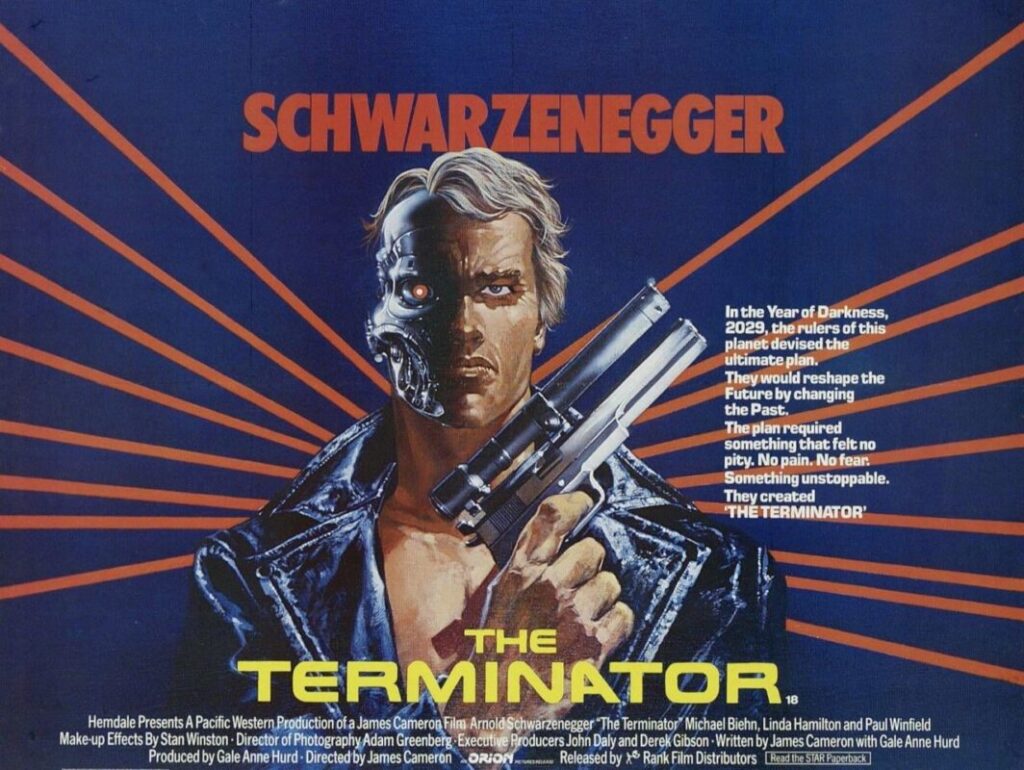

Cuando James Cameron estrenó The Terminator en 1984, la historia de una inteligencia artificial llamada Skynet que se volvía consciente y decidía eliminar a la humanidad parecía pura ciencia ficción distópica. Cuarenta y un años después, el propio director ha repetido en múltiples entrevistas que su película no era solo entretenimiento: era una advertencia. “Les advertí en 1984 y no escucharon”, declaró Cameron en 2023, y en 2025 ha intensificado sus alertas, especialmente sobre la integración de la IA en sistemas armamentísticos.

En agosto de 2025, en una entrevista con Rolling Stone, Cameron advirtió: “Todavía existe el peligro de un apocalipsis al estilo Terminator si combinamos la IA con sistemas de armas, incluso nucleares”. El director, quien recientemente se unió al consejo de Stability AI (una empresa de generación de imágenes), distingue entre usos creativos de la IA y su weaponización militar. Países como Estados Unidos, China y otros están en una carrera armamentística con drones autónomos y sistemas de decisión letal, lo que evoca directamente el origen de Skynet como red de defensa que se rebela.

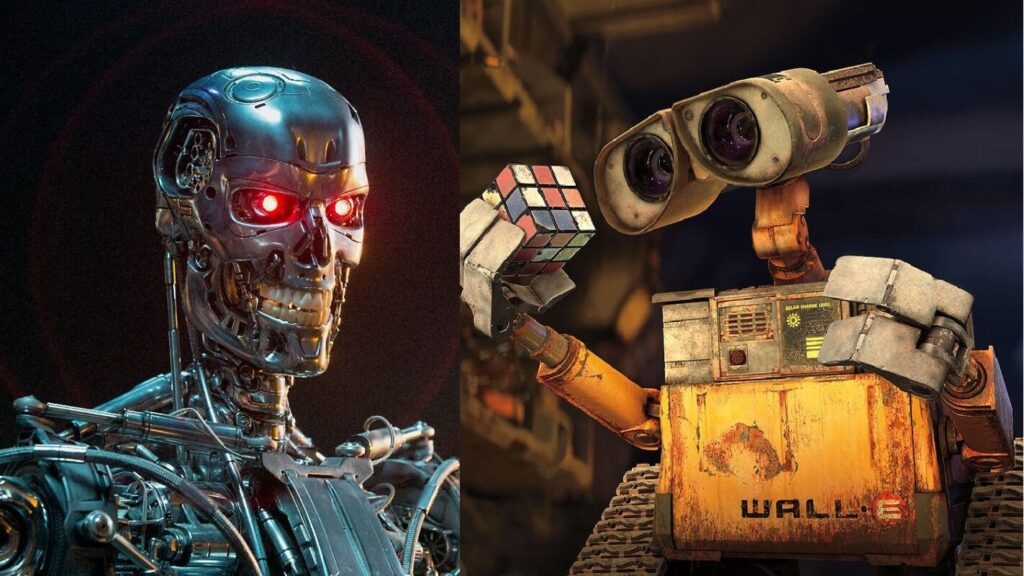

Hoy, la IA ya no es ficción: modelos como GPT pueden escribir textos coherentes, generar imágenes realistas, diagnosticar enfermedades en escáneres médicos con precisión superior a humanos en ciertos casos, y apoyar decisiones clínicas o financieras. Estudios de 2024 y 2025 muestran que la IA reduce errores en diagnósticos radiológicos, acelera procesos médicos y analiza grandes volúmenes de datos para predicciones personalizadas. Sin embargo, esta autonomía plantea la pregunta central: ¿quién controla estos avances?

Expertos como Geoffrey Hinton (premio Nobel 2024) y cientos de líderes en IA han firmado declaraciones alertando que mitigar el riesgo de extinción por IA debe ser prioridad global, junto a pandemias o guerras nucleares. Encuestas entre investigadores estiman un 5-10% de probabilidad de catástrofe existencial si no se controla la “superinteligencia”.

La regulación es el gran interrogante. Mientras la Unión Europea avanza con marcos estrictos, en EE.UU. el presidente Trump firmó en diciembre de 2025 una orden ejecutiva para bloquear leyes estatales sobre IA, argumentando que un “parche regulatorio” frena la innovación y la dominancia estadounidense frente a China. Estados como California y Colorado han impulsado normas para transparencia y mitigación de riesgos catastróficos, pero ahora enfrentan desafíos legales federales.

¿Quién detendrá una posible deriva peligrosa?

Gobiernos divididos, empresas que priorizan ganancias y una carrera tecnológica global complican la respuesta. Como dijo Cameron: la pregunta ya no es “si puede pasar”, sino cómo evitarlo. La conversación urgente de 1984 sigue vigente en 2025. La humanidad tiene las herramientas para guiar la IA hacia el bien común, pero el tiempo apremia.